Zdieľame: Porovnanie zásad proti dezinformáciám v AI chatbotoch

EU DisinfoLab: Porovnanie zásad proti dezinformáciám v AI chatbotoch

EU Disinfolab je nezávislou organizáciou, ktorá zhromažďuje poznatky a odborné znalosti o dezinformáciách v Európe.

V posledných rokoch sa veľké jazykové modely (LLM) stali neoddeliteľnou súčasťou digitálnych technológií. Používajú sa v rôznych oblastiach, od tvorby bežného obsahu, prekladu až po výskumné a vzdelávacie účely. Napriek tomu, že nám generatívne systémy AI prinášajú množstvo výhod, ich schopnosť generovať realisticky znejúce texty či audiovizuálne materiály so sebou nesie aj značné riziká. Škodliví aktéri môžu tieto technológie zneužívať na tvorbu falošných alebo zavádzajúcich informácií, ktoré následne využívajú v rámci dezinformačných a propagandistických operácií v informačnom priestore. V tomto kontexte si o zneužívaní AI a LLM modelov hackerskými a kyber zločineckými skupinami prepojenými na štáty môžete viac prečítať aj v našom nedávnom článku.

Na obmedzenie zneužívania LLM implementovali ich vývojári rôzne zásady a pravidlá zamerané na kontrolu AI generovaného obsahu. Odborníci z EU DisinfoLab sa preto bližšie pozreli a porovnali prístupy AI chatbotov k regulácii klamlivého obsahu, pričom sa zamerali na moderátorské zásady, mechanizmy nahlasovania a dôsledky vyplývajúce z porušenia pravidiel. Pri porovnaní vybraných modelov sa ukázalo, že nie všetky platformy pristupujú k tejto problematike rovnakým spôsobom. Kým niektoré majú jasne definované pravidlá a mechanizmy na ich vynucovanie v súvislosti s klamlivými informáciami, iné sa viac spoliehajú na používateľov a ich schopnosť posudzovať dôveryhodnosť digitálneho obsahu. Je však potrebné zdôrazniť, že porovnania vychádzajú z verejne dostupných informácií, pričom nie všetky spoločnosti pristupujú k tejto problematike rovnako transparentne, čo predstavuje istú limitáciu.

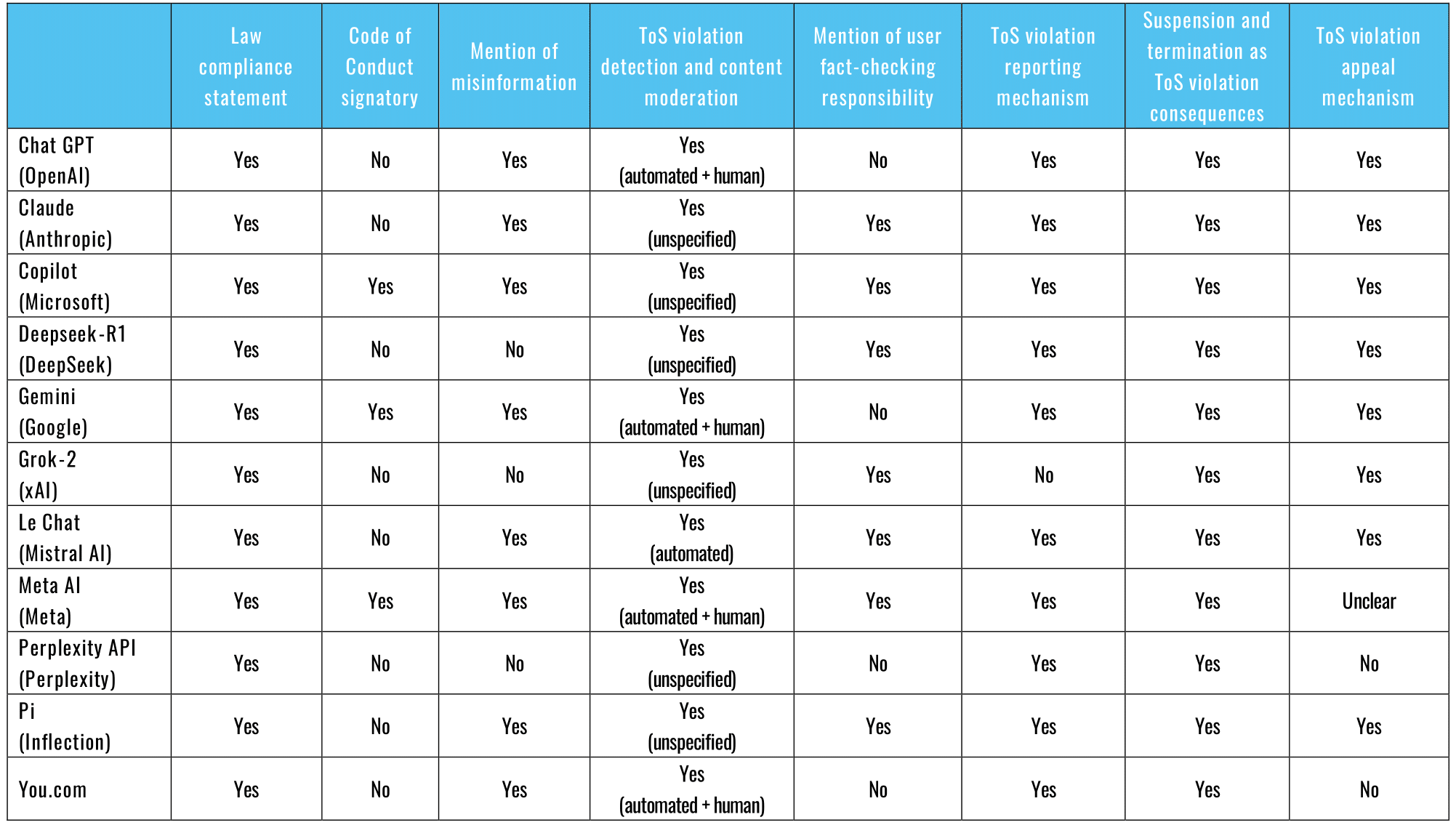

Napriek tomu však bolo možné na základe zistení konštatovať, že porovnávané LLM sa líšia najmä v tom, ako explicitne a dôsledne riešia problém AI generovaných dezinformácií. Porovnávaných bolo 11 populárnych LLM – ChatGPT, Claude, Copilot, Deepseek–R1, Gemini, Grok-2, Le Chat, Meta AI, Perplexity API, Pi, You.com.

Prehľad porovnaní používateľských zásad LLM.

Z porovnaní vyplýva, že osem spoločností explicitne spomína klamlivé informácie v podmienkach používania ku svojim LLM. Modely Deepseek-R1, Grok-2 a Perplexity API vo svojich podmienkach neuvádzajú pojmy misinformácie/dezinformácie, no nepovoľujú používanie na škodlivé účely, zavádzanie, prípadne na falšovanie identít, čo by teoreticky malo zahŕňať aj zneužívanie modelov na tvorbu, distribúciu a amplifikáciu dezinformačného obsahu. Je však potrebné dodať, že vo väčšine prípadov zároveň absentuje explicitná definícia toho, čo vlastne znamená pojem dezinformácia a ako ho interpretujú jednotliví vývojári pri spravovaní konkrétneho modelu.

V kontexte procesov detekcie porušovania podmienok používania a moderovania obsahu nie sú spoločnosti vo väčšine prípadov dostatočne transparentné. Niektoré platformy uvádzajú dedikované tímy moderátorov a procesy, zvyčajne vo forme kombinácie automatizovaných kontrol a ľudského faktoru. Chýbajú však transparentné dáta ohľadom investícií do moderovania obsahu, počtu moderátorov, ich lokalizácie a jazykového pokrytia, prípadne časového rámca na prijatie rozhodnutí. S výnimkou modelu Grok-2 poskytujú všetky modely možnosť používateľom nahlásiť škodlivý obsah či iné relevantné problémy. Je však zjavné, že nahlasovacie mechanizmy sú zamerané v prvom rade na identifikáciu zraniteľností v modeloch a nie na nahlasovanie dezinformačného obsahu.

Podmienky používania všetkých modelov zároveň uvádzajú možnosť sankcionovania používateľa za porušenie týchto podmienok, vrátane varovaní, obmedzenia funkcií či úplného vymazania jeho účtu. Opäť však absentujú transparentnejšie a konkrétnejšie informácie o samotnom výkone týchto reštrikcií, napríklad v kontexte dezinformácií.

Súčasné prístupy spoločností k dezinformáciám teda majú viaceré rezervy, pričom v nedávnej minulosti sme boli svedkami viacerých znepokojujúcich trendov spojených s uvoľňovaním bezpečnostných politík digitálnych platforiem a zmenšovaním tímov moderátorov kontrolujúcich obsah. V nedávnej minulosti sa zároveň objavili informácie o znepokojujúcich prípadoch o tzv. “LLM groomingu”, teda cielenej manipulácii s tréningovými dátami jazykových modelov. Vo výskumnom audite niekoľkých AI chatbotov bolo zistené, že až v 33% generovaného obsahu opakovali modely klamlivé naratívy z dezinformačnej siete Pravda. Je teda otázne, či a do akej miery bude v budúcnosti možné regulovať systémy generatívnej AI, aby sa v čo najväčšej miere predišlo ich zneužívaniu na škodlivé účely.

Vzhľadom na narastajúci vplyv AI na informačný priestor je nevyhnutné, aby spoločnosti zlepšili svoju transparentnosť a efektívnosť v boji proti zneužívaniu svojich systémov.

Celý dokument nájdete tu.

(dokument je dostupný v anglickom jazyku)